委员会提出了第一个人工智能法律框架,该框架解决了人工智能的风险,并使欧洲能够在全球发挥主导作用。

该监管提案旨在为人工智能开发者、部署者和用户提供有关人工智能具体用途的明确要求和义务。同时,该提案旨在减轻企业,特别是中小企业的行政和财务负担。

该提案是更广泛的人工智能一揽子计划的一部分,其中还包括更新后的人工智能协调计划。监管框架和协调计划将共同保障人工智能方面的人员和企业的安全和基本权利。它们还将加强整个欧盟对人工智能的吸收、投资和创新。

为什么我们需要人工智能规则?

拟议中的人工智能监管确保了欧洲人能够信任人工智能所能提供的东西。虽然大多数人工智能系统几乎没有风险,并且可以帮助解决许多社会挑战,但某些人工智能系统会产生风险,我们必须解决这些风险,以避免出现不良结果。

例如,通常不可能找出人工智能系统做出决定或预测并采取特定行动的原因。因此,评估某人是否处于不公平的不利地位可能会变得困难,例如在招聘决定或公共福利计划申请中。

尽管现有立法提供了一些保护,但不足以解决人工智能系统可能带来的具体挑战。

拟议规则将:

- 解决人工智能应用程序专门产生的风险;

- 提出一份高风险申请清单;

- 为高风险应用设定明确的人工智能系统要求;

- 定义人工智能用户和高风险应用程序提供商的具体义务;

- 在人工智能系统投入使用或投放市场之前,提出一致性评估;

- 建议在这种人工智能系统投放市场后强制执行;

- 提出欧洲和国家层面的治理结构。

基于风险的方法

监管框架定义了人工智能的4个风险级别:

- 不可接受风险

- 高风险

- 风险有限

- 风险最小或无风险

不可接受风险

所有被认为对人们的安全、生计和权利构成明显威胁的人工智能系统都将被禁止,从政府的社会评分到使用语音辅助鼓励危险行为的玩具。

高风险

被认定为高风险的人工智能系统包括用于以下领域的人工智能技术:

- 可能危及公民生命和健康的关键基础设施(如交通);

- 教育或职业培训,可能决定一个人接受教育的机会和一生的专业课程(例如考试成绩);

- 产品的安全组件(例如人工智能在机器人辅助手术中的应用);

- 就业、工人管理和自营职业的机会(例如用于招聘程序的简历分类软件);

- 基本的私人和公共服务(例如,信用评分剥夺了公民获得贷款的机会);

- 可能干扰人民基本权利的执法(例如对证据可靠性的评估);

- 移民、庇护和边境管制管理(例如核实旅行证件的真实性);

- 司法和民主进程(例如,将法律适用于一系列具体事实)。

高风险人工智能系统在投放市场之前将受到严格的义务约束:

- 适当的风险评估和缓解系统;

- 为系统提供高质量的数据集,以最大限度地减少风险和歧视性结果;

- 记录活动以确保结果的可追溯性;

- 提供有关系统及其用途的所有必要信息的详细文件,供当局评估其合规性;

- 向用户提供清晰和充分的信息;

- 采取适当的人力监督措施,将风险降至最低;

- 高水平的鲁棒性、安全性和准确性。

所有远程生物识别系统都被认为是高风险的,并受到严格的要求。原则上禁止在公共场所使用远程生物识别进行执法。

对狭义的例外情况进行了严格的定义和管理,例如在必要时寻找失踪儿童,防止特定和迫在眉睫的恐怖主义威胁,或侦查、定位、识别或起诉严重刑事犯罪的肇事者或嫌疑人。

此类使用须经司法或其他独立机构授权,并在时间、地理范围和搜索数据库方面受到适当限制。

风险有限

有限风险是指具有特定透明度义务的人工智能系统。当使用聊天机器人等人工智能系统时,用户应该意识到他们正在与机器交互,这样他们就可以在知情的情况下做出继续或后退的决定。

风险最小或无风险

该提案允许免费使用风险最小的人工智能。这包括支持人工智能的视频游戏或垃圾邮件过滤器等应用程序。欧盟目前使用的绝大多数人工智能系统都属于这一类。

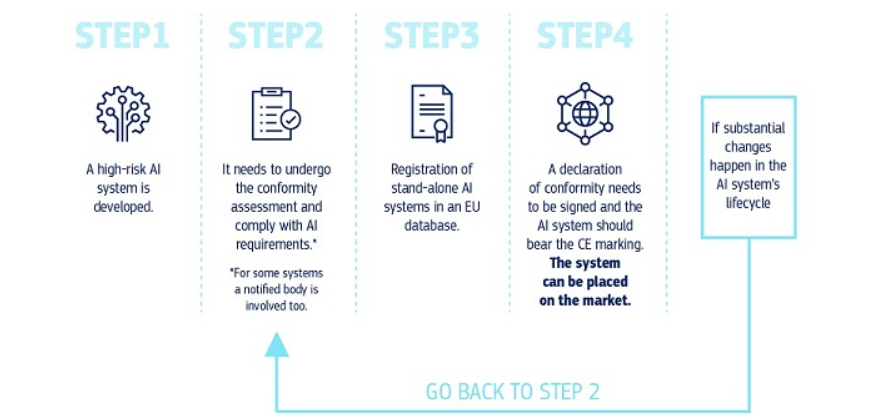

对于高风险人工智能系统的提供商来说,这一切在实践中是如何运作的?

一旦人工智能系统上市,当局就负责市场监控,用户确保人工监督和监控,供应商也有一个上市后的监控系统。供应商和用户还将报告严重事件和故障。

经得起未来考验的立法

由于人工智能是一种快速发展的技术,该提案具有经得起未来考验的方法,允许规则适应技术变化。人工智能应用程序即使在投放市场后也应保持值得信赖。这需要供应商持续进行质量和风险管理。

接下来的步骤

根据委员会2021年4月的提议,该法规可能在2022年末/2023年初的过渡期内生效。在此期间,将规定和制定标准,建立的治理结构将投入运作。2024年下半年是该法规最早适用于已准备好标准并进行第一次符合性评估的运营商的时间。

- 登录 发表评论